Data é o novo petróleo na era digital, e a proposta de Elon Musk para uma AGI open-source levanta questões significativas sobre controle de dados e ética no treinamento de IA. Este artigo investiga os desafios e perigos envolvidos.

A Revolução da Inteligência Artificial Geral

A revolução da Inteligência Artificial Geral (AGI) promete transformar radicalmente a maneira como interagimos com a tecnologia. Diferente da inteligência artificial estreita (IA estreita), que é projetada para executar tarefas específicas, a AGI aspira a alcançar níveis de inteligência e entendimento comparáveis aos humanos, podendo realizar qualquer tarefa cognitiva que um ser humano seja capaz de fazer. Entre os principais objetivos da pesquisa em AGI está a criação de sistemas que possam aprender, raciocinar e adaptar-se a novos cenários com uma flexibilidade semelhante à mente humana.

Empresas como OpenAI e DeepMind estão na vanguarda dessa pesquisa. A OpenAI, inicialmente cofundada por Elon Musk, busca desenvolver AGI de maneira que beneficie toda a humanidade. Já a DeepMind, adquirida pelo Google, tem se destacado por avanços significativos, como o AlphaGo, que derrotou campeões humanos no jogo de Go, demonstrando a capacidade surpreendente dessas tecnologias.

Previsões sobre quando a AGI será alcançada variam consideravelmente. Enquanto alguns especialistas projetam que isso pode ocorrer nas próximas décadas, outros são mais céticos e acreditam que a AGI é ainda um objetivo distante. A definição de AGI também é tema de debate, com opiniões divergentes sobre o que constitui “inteligência geral”. Modelos de linguagem modernos, como GPT-3 da OpenAI, já mostram capacidades notáveis, mas ainda estão longe de compreender e raciocinar com a profundidade de um ser humano.

A abordagem aberta e colaborativa de algumas dessas pesquisas, como as lideradas pela OpenAI, busca mitigar os riscos associados à AGI, promovendo transparência e inovação. No entanto, esse mesmo caráter aberto levanta questões éticas sobre o uso indiscriminado e as implicações morais de treinar IA com dados amplamente disponíveis. À medida que avançamos nessa revolução tecnológica, é crucial equilibrar a inovação com uma reflexão profunda sobre as responsabilidades e riscos envolvidos.

Elon Musk e Seu Papel na Evolução da IA

Elon Musk, um dos nomes mais ressonantes no campo da tecnologia contemporânea, tem desempenhado um papel crucial na evolução da Inteligência Artificial (IA). Inicialmente, Musk ganhou notoriedade com a SpaceX e a Tesla, onde revolucionou as indústrias aeroespacial e automotiva, respectivamente. No entanto, sua influência não parou por aí. Em 2015, ele cofundou a OpenAI, com o objetivo de direcionar a pesquisa em IA para caminhos mais seguros e benéficos para a humanidade.

Musk tem uma visão peculiar sobre IA. Ele vê o potencial da Inteligência Artificial Geral (AGI) como algo que pode tanto beneficiar quanto ameaçar a humanidade. Sua decisão de apoiar uma abordagem open-source na OpenAI foi fundamentada na crença de que a transparência poderia mitigar os riscos associados à corrida armamentista de IA. No entanto, essa postura tem sido alvo de críticas, uma vez que a abertura irrestrita talvez possa acelerar o desenvolvimento não supervisionado de tecnologias perigosas.

No campo da AGI, Musk frequentemente advertiu sobre os riscos existenciais, destacando a necessidade de um desenvolvimento ético e supervisionado. Suas interações com outras entidades tecnológicas, como Google e Facebook, refletem um esforço contínuo para criar consenso sobre essas preocupações, apesar de nem sempre encontrar terreno fértil.

Além de suas contribuições empresariais, Musk tem investido pessoalmente em pesquisa de IA e divulgado suas preocupações em fóruns de alto nível, como a conferência do MIT e o programa “Joe Rogan Experience”. Seus pronunciamentos são frequentemente polarizadores, revelando uma tensão inerente nas ambições tecnológicas de sua trajetória.

Assim, Musk se posiciona como um guardião ambíguo do futuro da IA, impulsionando seus limites enquanto clama por uma vigilância ética rigorosa.

Desafios Éticos na IA e AGI

Elon Musk não é estranho aos debates éticos envolvendo a inteligência artificial, principalmente quando se trata da AGI open-source. Um dos principais desafios éticos é o viés incorporado nos sistemas de IA. Dados não representam a sociedade de maneira equitativa e as IAs treinadas nesses dados podem perpetuar estereótipos e injustiças. A falta de diversidade nos dados e na equipe de desenvolvimento pode resultar em sistemas que beneficiam apenas um grupo específico, exacerbando desigualdades existentes.

Outro ponto crítico é a privacidade. À medida que as IAs se tornam mais sofisticadas, elas requerem vastas quantidades de dados pessoais para treinar e operar. Isso levanta questões sobre como esses dados são coletados, armazenados e utilizados. É essencial garantir que os dados sejam tratados de maneira ética, protegendo a privacidade dos usuários e evitando abusos.

A responsabilidade é um desafio crescente. Com a implementação de sistemas de IA em áreas cruciais como saúde, finanças e segurança, surge a pergunta: quem é responsável quando algo dá errado? A ausência de regulamentações claras agrava essa questão, especialmente no contexto de uma AGI open-source, onde múltiplos atores podem estar envolvidos no desenvolvimento e implementação.

Tópicos emergentes, como armas autônomas letais, representam um risco significativo. A possibilidade de criar máquinas capazes de tomar decisões de vida ou morte sem intervenção humana suscita preocupações profundas sobre a moralidade e o controle dessas tecnologias. Similarmente, a desinformação habilitada por IA, como deepfakes, pode desestabilizar sociedades inteiras e minar a confiança pública.

O desemprego tecnológico é outra preocupação significativa. A automação impulsionada por IA ameaça substituir milhões de empregos, criando tensões econômicas e sociais. A comunidade de IA está começando a abordar essas questões, mas há uma necessidade urgente de um debate global e de políticas robustas que garantam uma implementação ética e justa da IA, especialmente no contexto da AGI open-source.

A Dicotomia dos Dados e o Controle do Usuário

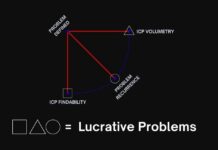

A metáfora de “dados como o novo petróleo” ilustra a extraordinária importância e valor econômico dos dados na era digital. Sem dúvida, as grandes empresas de tecnologia, ou Big Techs, alicerçam seu poder e influência no vasto controle e processamento desses dados. Quanto mais dados uma companhia detém, mais precisa e eficaz sua IA pode ser, reforçando um ciclo vicioso onde as grandes empresas continuam a crescer enquanto usuários comuns permanecem marginalizados.

O controle dos dados pelos usuários surge como um contraponto necessário a essa dinâmica. Dar ao usuário maior controle sobre seus próprios dados implica em mais transparência e autonomia, permitindo que decidam como e por quem seus dados serão utilizados. No entanto, isso traz desafios significativos, como a complexidade de implementar medidas de segurança que protejam efetivamente os dados sem comprometer a usabilidade e a performance das aplicações.

Elon Musk, ao defender uma AGI open-source, imagina um futuro onde o conhecimento da IA esteja ao alcance de todos, supostamente nivelando o campo de jogo. No entanto, essa visão idealista não endereça diretamente a questão do controle de dados. Uma AGI de código aberto pode aumentar ainda mais a coleta de dados, uma vez que mais entidades terão acesso às ferramentas para coletar e analisar informações de usuários. Isso pode gerar novos desafios éticos, sobretudo no contexto de quem possui os dados e como são utilizados.

Com mais controle sobre seus dados, os usuários poderiam mitigar alguns dos riscos associados ao poder desmedido das Big Techs. No entanto, o equilíbrio entre controle de dados e inovação continua sendo uma linha tênue, especialmente quando se considera o impacto potencial de uma AGI open-source moldada pelos princípios de autonomia e ética.

Riscos e Potenciais da AGI

Os riscos potenciais associados ao desenvolvimento da AGI (Inteligência Artificial Geral) são vastos e complexos, incluindo cenários de risco existencial que algumas organizações alertam ser iminentes. O conceito de uma AGI com capacidades comparáveis ou superiores às humanas suscita temores de perda de controle e eventuais catástrofes. Preocupações incluem a possibilidade da AGI assumir funções críticas, tomar decisões autônomas com consequências imprevistas ou até mesmo priorizar objetivos que possam colocar a humanidade em risco.

Ao mesmo tempo, os benefícios potenciais não podem ser ignorados. Avanços tecnológicos proporcionados pela AGI prometem transformar áreas como medicina, educação, e infraestrutura urbana. A otimização de diagnósticos médicos, personalização educativa e gestão eficiente de recursos naturais são exemplos de melhorias tangíveis que uma AGI pode proporcionar à sociedade.

No entanto, para equilibrar inovação e ética, é crucial implementar princípios transparentes e inclusivos no desenvolvimento da AGI. **Preocupações éticas** incluem garantir decisões alinhadas com valores humanos, proteger a privacidade dos dados e evitar preconceitos embutidos nos algoritmos. Uma abordagem colaborativa e regulada, que envolva governos, acadêmicos e o público, é essencial para mitigar riscos e maximizar os benefícios.

O desafio reside em criar políticas e práticas que garantam uma AGI segura e benéfica, enquanto se fomenta a inovação. Neste contexto, a luta de Elon por uma AGI open-source desperta tanto esperanças quanto inquietações, especialmente pela delicada linha entre transparência e controle.

Concluindo

A visão de Elon Musk sobre uma AGI open-source apresenta tanto oportunidades quanto riscos significativos. O equilíbrio entre inovação tecnológica e considerações éticas será crucial para garantir que essas questões sejam abordadas de forma justa e segura, promovendo um futuro onde os dados e o controle sejam mais equitativos.